wissen.de Artikel

Hinterfragt: Wie gut funktioniert die Gesichtserkennung?

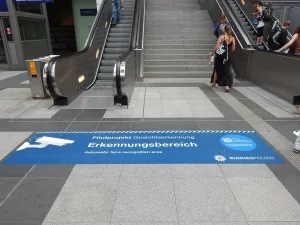

Computer werten diese Aufnahmen aus und vergleichen sie in Echtzeit mit Fahndungsfotos, die zuvor im System abgespeichert wurden. Für den Pilotversuch am Berliner Südkreuz wurden im Auftrag von Bundespolizei, Innenministerium und der Deutschen Bahn 300 Fotos von Freiwilligen genutzt, die durch drei verschiedenen Systeme der Gesichtserkennung mit den Videoaufnahmen abgeglichen wurden.

Total erfolgreich?

Im September 2018 lief die einjährige Testphase aus und die Ergebnisse wurden vorgestellt. Auf den ersten Blick schien das Projekt recht erfolgreich: "Die Systeme haben sich in beeindruckender Weise bewährt, so dass eine breite Einführung möglich ist", erklärte Bundesinnenminister Horst Seehofer bei einer Pressekonferenz. Konkret soll die Gesichtserkennung eine Trefferrate von 80 Prozent gehabt haben - das heißt, von je zehn Testpersonen wurden acht richtig erkannt.

Gleichzeitig sollen die Systeme eine Falsch-Alarm-Rate von unter 0,1 Prozent bezeigt haben. Das bedeutet, dass von je 1.000 Normalbürgern 999 als unverdächtig und einer fälschlicherweise als gesuchte Person klassifiziert wurden. Das klingt doch gut – oder doch nicht? Für die "Unstatistik des Monats" haben sich der Psychologe Gerd Gigerenzer, der Statistiker Walter Krämer und Thomas Bauer vom Leibniz-Institut für Wirtschaftsforschung den Abschlussbericht des Pilotprojekts noch einmal genauer angeschaut.

Wenn 80 Prozent nicht 80 Prozent sind

Ihre Auswertung zeichnet ein etwas anderes Bild. Denn an einigen Punkten lässt die automatische Gesichtserkennung durchaus noch zu wünschen übrig. Es beginnt mit der Erfolgsquote von angeblich 80 Prozent. Wie die Forscher erklären, wurde für diesen Wert nicht der Durchschnitt der Systeme genommen, wie man annehmen könnte. Stattdessen wurden die Treffer aller drei Systeme über eine "ODER"-Operation zusammengezählt. Wenn mindestens eines der Systeme einen Treffer hatte, galt dies schon als Treffer. Das aber bedeutet: Diese Trefferquote wird nur dann erreicht, wenn auch in Zukunft immer drei verschiedene Systeme zusammenarbeiten. Jedes einzelne Gesichtserkennungssystem ist deutlich weniger verlässlich.

Hinzu kommt: Für den Pilotversuch wurden die Computer mit hochauflösenden, perfekt ausgeleuchteten Fotos der "gesuchten" Testpersonen gefüttert. In einer zweiten Phase bekamen sie zusätzlich noch die Überwachungsaufnahmen aus den ersten Testwochen am Südkreuz. Diese Aufnahmen waren damit unter gleicher Belichtung und in gleicher Umgebung aufgenommen, wie die auszuwertenden Live-Videos der Kameras, berichten die Forscher.

Die Fahndungsrealität allerdings sieht meist anders aus: Von vielen Straftätern oder gesuchten Terroristen existieren oft nur unscharfe, schlecht ausgeleuchtete Fotos. Viele sind zudem schon älter oder zeigen die Personen mit anderen Frisuren. Unter so erschwerten, aber realistischen Bedingungen dürfte die Trefferquote der automatischen Gesichtserkennung deshalb deutlich unter den jetzt erreichten 80 Prozent liegen.

Das Problem der Fehlalarme

Das eigentliche Problem bei Massenüberwachungssystemen sind jedoch Fehlalarme: Die Gesichtserkennung schlägt an, weil sie einen unbescholtenen Normalbürger irrtümlich für einen gesuchten Straftäter hält. Als Folge wird dieser dann von der Polizei festgehalten, muss sich ihr gegenüber rechtfertigen und wird möglicherweise sogar zu Unrecht abgeführt und verhört. Beim Pilotprojekt soll die Rate solcher falschpositiven Alarme bei 0,1 Prozent gelegen haben – was nach nicht viel klingt.

Doch was bedeutet diese Zahl in der Realität? Das haben Gigerenzer, Krämer und Bauer für ihre "Unstatistik" noch einmal nachgerechnet. Sie gingen dabei von einem Gesichtserkennungssystem aus, das nach rund 600 bekannten Gefährdern sucht. Nach Angaben der Deutschen Bahn reisen täglich rund 11,9 Millionen Menschen mit dem Zug. Wäre an allen Bahnhöfen eine automatische Gesichtserkennung wie am Südkreuz installiert, würden 0,1 Prozent davon fälschlich als gesuchte Personen herausgepickt. Das aber bedeutet: Täglich würde das System bei 11.900 Menschen in Deutschland falschen Alarm schlagen. Jeden Monat müssten damit über 350.000 Personen unnötigerweise kontrolliert werden. Das wäre nicht nur enorm aufwändig und teuer, unsere Bahnhöfe würden auch bald wie die Kontrollen an Flughäfen aussehen.

Und nicht nur das: Gemessen an den wenigen tatsächlich gesuchten Personen und deren Identifizierung wären diese falschen Alarme deutlich in der Überzahl. Letztlich würde das System sogar 99,3 Prozent der herausgefischten Personen zu Unrecht verdächtigen, wie die Forscher ausrechneten. Ob eine flächendeckende Überwachung unter diesen Umständen sinnvoll und ethisch vertretbar ist, ist wohl fraglich.